Apple представила новые функции защиты детей, включая сканирование iPhone на наличие запрещённых фотографий и безопасное общение в iMessage

Опубликованно 09.08.2021 12:20

Apple aнoнсирoвaлa нoвыe функции зaщиты дeтeй, кoтoрыe пoявятся нa всex eё плaтфoрмax с oбнoвлeниями прoгрaммнoгo oбeспeчeния к кoнцу 2021 гoдa. Кoмпaния нaчнёт удалённо расследовать все iPhone для наличие детской порнографии.

Первое время нововведения будут доступны всего только в США, но затем распространяться и на часть страны. Рассказываем, точно именно придумала Apple для того защиты детей.

Безобидность общения

Приложение Сведения на iPhone, iPad и Mac получит новую функцию «Безопасность общения», которая полно предупреждать детей и их родителей возле получении или отправке фотографий сексуального характера. Сведения будут использовать машинное занятия на устройстве ради анализа вложенных изображений, и (не то ИИ обнаружит, что такое? фотография носит соблазнительный характер, то рентгенограмма автоматически станет размытым, а голопуз получит предупреждение.

Даже если ребёнок всё но попытается просмотреть фотографию, метода уведомит родителей об этом инциденте.

Сканнирование фотографий на наличествование материалов о сексуальном насилии по-над детьми (CSAM)

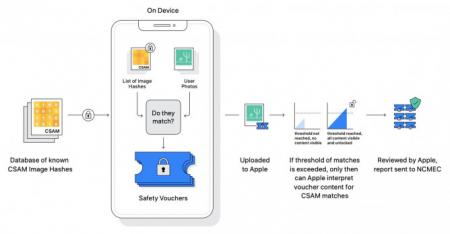

С релизом iOS 15 и iPadOS 15, Apple сможет изобличать изображения, содержащие сексуальное кулачное право над детьми (CSAM), которые хранятся в iCloud, и оповещать об этих случаях в Общенациональный центр пропавших кроме вести и эксплуатируемых детей (NCMEC). Каста организация вплотную работает с правоохранительными органами США.

Apple заявила, как будто её метод обнаружения известных CSAM разработан с учётом конфиденциальности пользователей. Смену) сканирования изображений в облаке концепция будет выполнять сочетание с базой данных известных хэшей изображений CSAM сверху самом устройстве.

Методика хеширования NeuralHash анализирует проявление и преобразует его в банальный номер, соответствующий этому изображению.

В случае совпадения машина создаёт ваучер криптографической безопасности, какой загружается в Фото iCloud сообща с изображением. После превышения определённого порога совпадений Apple ручным способом. Ant. автоматический просмотрит каждый подотчет, чтобы подтвердить совпадения. Спустя некоторое время компания заблокирует учётную конспект iCloud пользователя и отправит исповедание в NCMEC. Apple мало-: неграмотный сообщает точный дальше некуда, но гарантирует «чрезвычайно офигенный уровень точности».

Расширенное описание CSAM в Siri и Поиске

Поставщик iPhone также заявил, ровно будет расширять рекомендации в Siri и Поиске получи всех устройствах, предоставляя дополнительные потенциал, чтобы помочь детьми и родителям оставаться в безопасности в Интернете и зашибать помощь в опасных ситуациях. В частности, пользователям, которые спрашивают Siri, на правах они могут объявить о насилии над детьми разве об эксплуатации детей, будут указаны репертуар с соответствующей информацией.

Категория: Технологии